„Kiedyś rycerze, dziś bezrobotni”

(Stanisław Staszewski, Knajpa morderców)

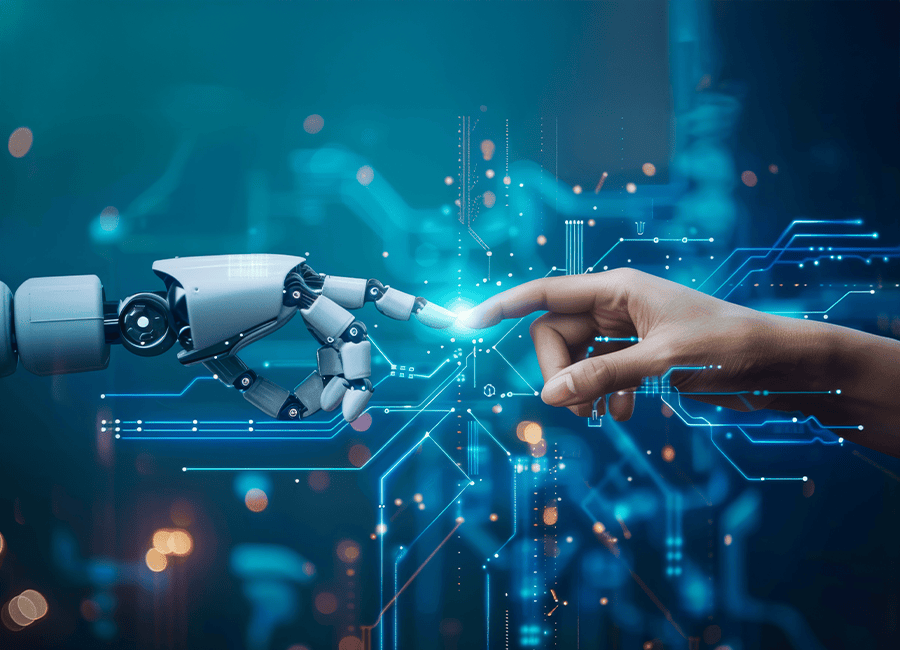

Jesteśmy świadkami czasów w których zrodził się kolejny etap procesu globalnej automatyzacji. Po rewolucji agralnej, przemysłowej, komputerowej, internetowej, mediów społecznościowych, mamy kolejną, rewolucję sztucznej inteligencji. Czy to były/są rewolucje, czy bardziej ewolucje, zależy od punktu widzenia i o wiele ważniejsze jest to, że wszystkie te procesy, są fizyczną emanacją dokładnie tego samego procesu automatyzacji. Obiektywne jest, że:

Konsekwentnie i nieprzerwanie optymalizujemy nasze życie, transformując jego kolejne obszary poza przestrzeń naszego bezpośredniego działania

Przy każdej takiej transformacji rodzą się – już tradycyjnie – lęki związane ze strachem o przyszłość. Pytania w rodzaju, czy będziemy mieli pracę, czy świat sobie poradzi, jak będą funkcjonować kolejne pokolenia, są naturalne i wciąż te same. Nie ma różnicy w obawach pracownika fizycznego w osiemnastowiecznej manufakturze tkalniczej w Anglii, który patrzył na powstające obok fabryki z maszynami parowymi, a obawach kierowcy taksówki w Kalifornii, który widzi coraz bardziej udane testy aut autonomicznych. Obydwaj się boją, obawy każdego z nich są uzasadnione a przyszłość w znacznej mierze przesądzona. Tak samo jak oczywiste jest dzisiaj, że nikt już ręcznie nie będzie tkał (poza pasjonatami i artystami), tak samo oczywiste jest, że za jakiś czas, nikt nie będzie już kierował taksówkami (poza pasjonatami i tymi z szoferami).

Sztuczna inteligencja – będę używał tej nazwy, choć dyskusyjne jest, czy to, co zwykliśmy tak nazywać, jest inteligentne – spowoduje, że kolejny obszar naszego działania, myślenie, może zostać delegowany do procesów automatycznych i przestanie być naszą domeną wyłączną. Maszyny, komputery będą to robić lepiej od nas i przestanie mieć sens i przydatność abyśmy to my myśleli. Samo zniesienie konieczności robienia kolejnej rzeczy w naszym życiu, brzmi atrakcyjne, ale to czego się boimy, to fakt, że możemy być mniej (lub prawie wcale) potrzebni. Bo skoro

już od dawna prawie nie potrzeba naszej siły fizycznej a w przyszłości przestanie być potrzeba naszej inteligencji

to co będziemy robić, co będziemy mogli sprzedać na rynku pracy? Nie chcę skupiać się na roztrząsaniu tych wątpliwości, ale nie zaniecham napomknąć, że po dwustu latach rewolucji przemysłowej, wkopanie kabla w moim ogrodzie robiła koparka w której siedział i sterował nią człowiek (czyli jednak on a nie ona sama) a zakupy ze sklepu do domu wciąż muszę przynosić sam. Dwieście lat i takie ogromne automatyzacyjne zaniedbania o skali grubej wpadki! Duże społeczne zmiany najczęściej nie są natychmiastowe i pomimo rewolucyjnych etykiet, zazwyczaj wdrażane są ewolucyjnie, co daje czas na adaptację (to dobrze). Realne i poważne zagrożenia moim zdaniem, leżą gdzie indziej, ale o tym później.

Chciałbym opowiedzieć o tym co w obszarze AI rodzi moim zdaniem największy potencjał i to ten bardziej ekscytujący, rewolucyjny. Zdecydowanie nie są tym duże modele językowe (LLM). Dlaczego? Wszelkie przejawy automatyzacji inteligencji oparte o tworzenie statystycznych modeli naszej ludzkiej inteligencji, będą miały ogromne ograniczenie. Jakie? Ograniczeniem tym jest właśnie nasza inteligencja. Zobaczmy jak LLM i struktury pokrewne ją pozyskują i jak się uczą:

Gdyby nawet udało się zgromadzić całą sumę wiedzy ludzkości (jesteśmy blisko, choć na razie słabo odróżniamy głupotę od mądrości), gdyby nawet udało się opracować stuprocentowo skuteczne algorytmy uczenia (prawie mamy), gdyby do tego udało się opracować strukturę sieci, która potrafiła by operować na takiej wiedzy (jesteśmy już blisko), to nasza maszyna nie będzie w stanie wyjść poza tą inteligencję, która ją zasiliła (choć muszę przyznać, że spotykam czasem zdania odrębne). Dlatego moim zdaniem, to nie twory pokroju LLM dostarczą nam AGI (Artificial General Intelligence, tej prawdziwej, ogólnej inteligencji), choć te pierwsze są i będą skutecznym narzędziem do wielu zadań.

Przyjrzyjmy się innej koncepcji, nad którą jak trochę wiemy, trochę się domyślamy, pracują wszystkie liczące się ośrodki AI:

Najważniejszy na tym diagramie jest brak „Suma wiedzy ludzkości”. Tak, będziemy trenowali sieć, nie dostarczając jej wiedzy jaką zgromadziliśmy. To szokujące. Jak to możliwe aby tworzyć struktury posiadające inteligencję a nie bazujące na naszej, ludzkiej? Zasada jest prosta do zrozumienia i trochę mniej prosta do implementacji. Dość zauważyć, że skoro nasza inteligencja startowała od zera, nie czerpała z innej, wzorcowej inteligencji (przepraszam klasycznych kreacjonistów) i sama się wykształciła, to nic nie stoi na przeszkodzie aby inna jej forma zrobiła podobnie.

Pierwszy przykład to algorytm „AlphaGo Zero” grający w grę Go, który nie uczył się na przykładowych partiach rozgrywanych przez ludzi, całą wiedzę o grze Go zdobył od zera, ucząc się (głębokie uczenie przez wzmacnianie) sam ruchów i zasad. Jego proces nauczania był w dużej mierze losowy, tak jakby na „oślep” wykonywać kolejne ruchy a wiedzę czy robi dobrze czy źle czerpał z jednej, jedynej informacji (funkcji sukcesu), czy wolno wykonać taki ruch czy nie i czy przegrał czy wygrał. Wystarczyło kilka godzin wzajemnej gry dwóch takich algorytmów, aby wytrenowały się do poziomu pokonywania dowolnego ludzkiego mistrza w grze Go. Godziny uczenia prawdziwej sztucznej inteligencji w konfrontacji z naszą ludzką trenowaną tysiące lat i przegrywamy z kretesem. Nie wiemy jaką wiedzę AlphaGo Zero wytrenował, nie znamy jej kształtu ani nie umiemy jej scharakteryzować, widzimy tylko, że ruchy które ten algorytm wykonuje, są czasami tak dziwne i wydawałoby się głupie, że trudno uwierzyć, że prowadzą one do sukcesu, ale właśnie tak się dzieje. AlphaGo Zero ogrywa nas inaczej niż my dajemy się ogrywać, ma inne zasady, inną inteligencję w tym zakresie, w ten sposób ten algorytm jest prawdziwie sztucznie inteligentny.

Drugi przykład to w zasadzie historia, opowieść, jak twórcy LLM’ów próbowali osiągnąć sukces w rozwiązywaniu zadań matematycznych z geometrii. Długi czas nie udawało się przekroczyć poziomu 1 do 2 na 10 zadań na poziomie światowym. Każde takie zadanie to kilka dni pracy wysokiej klasy matematyka a sieć radziła sobie co prawda w kilka godzin ale ze słabą jeszcze efektywnością. Przełom nastąpił kiedy porzucono trenowanie sieci na naszym naukowym zbiorze reguł, twierdzeń, na setkach tysięcy zadań i ich rozwiązań wykonanych przez ludzi. Punktem wyjścia była czysta sieć neuronowa, niewiedząca nic o matematyce i geometrii. Sieć taka karmiona była figurami geometrycznymi i ich zestawami (generowała je inna sieć), oraz funkcją sukcesu, która mówiła jakie podstawowe zasady tkwią w matematyce i geometrii i że muszą być spełnione. I tak jak gatunek ludzki przez dziesiątki tysięcy lat budował wiedzę o matematyce i geometrii, tak sieć ta wytworzyła sobie swoją własną naukę na ten temat, zaobserwowała, odkryła w ciągu dni, godzin, jak działa świat w tym zakresie, stworzyła sobie własną naukę. Jaką? Nie wiemy. Efekt jest taki, że na dzisiaj rozwiązuje 6 na 10 z wyżej wspomnianych zadań. Czyli stworzyła chwilowo jeszcze „gorszą” niż nasza formę inteligencji, ale zrobiła to tysiące tysięcy razy szybciej i możemy domniemywać, że w jej zasięgu jest nas przegonić. Podsumujmy:

AGI powstanie na pewno i prawdopodobnie powstanie nie bazując wyłącznie na naszej inteligencji

Znalazło się tu stwierdzenie „nie wyłącznie” bo przecieki mówią, że aktualnie dobre wyniki daje łączenie obu mechanizmów a czy to ma sens, musimy jeszcze poczekać. To jest naprawdę ciekawa historia i wszystko było by pięknie, niestety jest małe „ale”. Zwróćmy uwagę na drugi z diagramów i element o nazwie „Funkcja sukcesu”. W grze Go funkcja sukcesu jest trywialna, zwracać może np. 1 dla wygranej, i 0 przeciwnym przypadku. Określić funkcję sukcesu dla rozwiązywania zadań z matematyki to już nie jest proste. I niestety tak jest dla większości dziedzin, dość powiedzieć, że:

Dajcie mi funkcję sukcesu a zbuduję Wam inteligencję

Podobne problemy pojawiają się także przy realizacji elementu „Dane z rzeczywistości”, tu musimy wyposażyć AGI w coś na kształt zmysłów a to proste nie jest. Zauważmy analogię do homo sapiens, jako funkcje sukcesu gatunek nasz obrał sobie przetrwanie (żyjesz 1, nie żyjesz 0) a dane pobiera wzrokiem, słuchem, smakiem, zapachem i dotykiem i to, tylko to (no jeszcze odrobinę czasu), wystarczyło aby doprowadzić gatunek do stanu z dzisiaj.

Podsumowując albo nie, pomijając odpowiedzi na kilka trudnych pytań, kończę ze spóźnionymi cokolwiek życzeniami na nowy 2026 rok, życzę nam wszystkim aby choć raz, choć raz w historii, ta nowa szansa jaką daje nam AGI przyniosła nam, ludzkości, wyłącznie dobre rzeczy. I to pomimo to, że niestety jak zawsze, istnieje realne i poważne zagrożenie (zbiegające od pewności), że tak się nie stanie.

Do zobaczenia w świecie AGI

Krzysztof Olszewski

Dyrektor Technologii i Architektury Oprogramowania

Krzysztof Olszewski

Dyrektor Technologii i Architektury Oprogramowania